Giải quyết lỗi 403 Truy cập bị từ chối khi quét trang web bằng Python

Sora Fujimoto

AI Solutions Architect

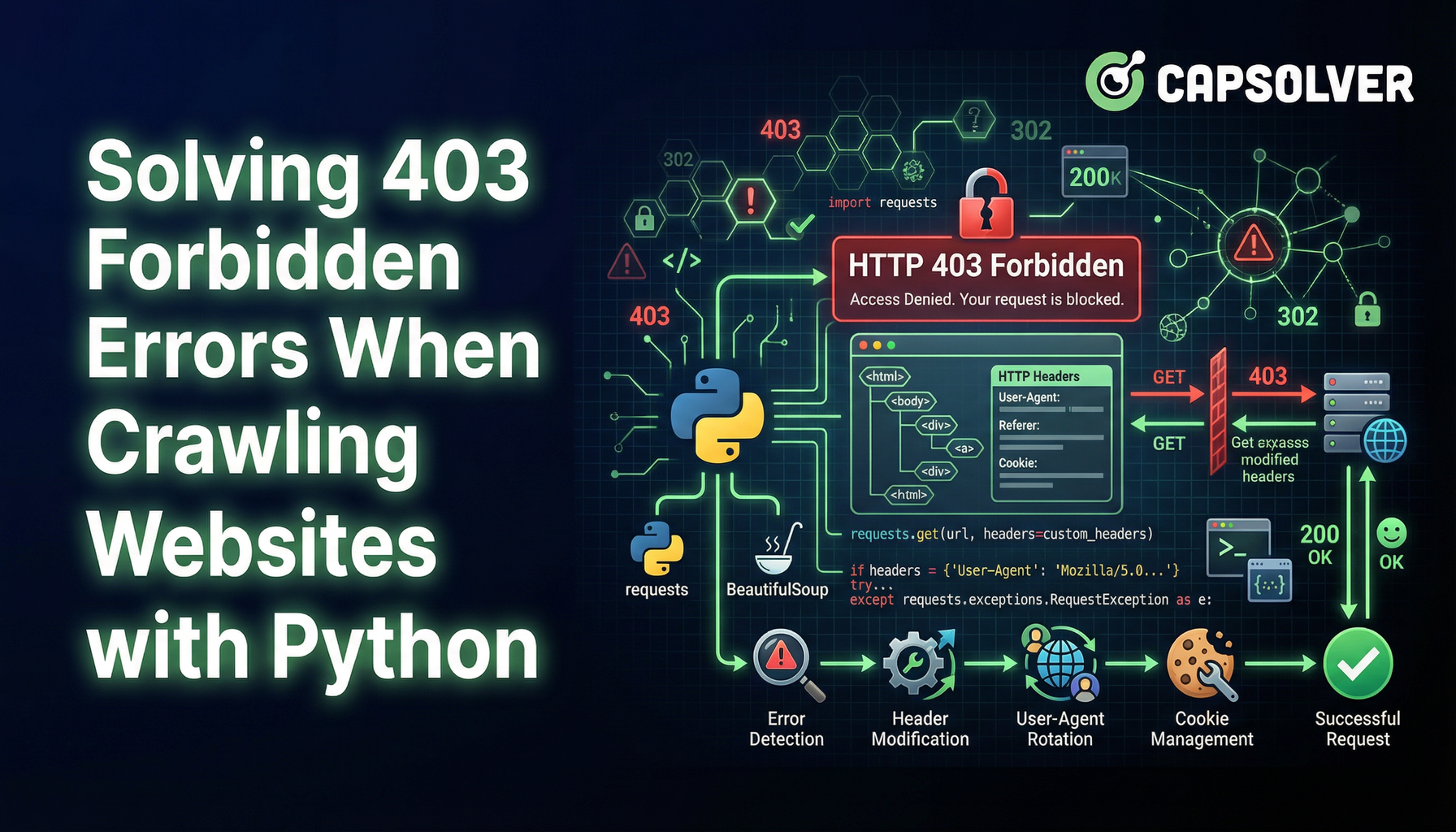

Quét trang web là kỹ thuật quý giá để trích xuất dữ liệu từ các trang web. Tuy nhiên, gặp phải lỗi 403 Forbidden có thể là một rào cản lớn. Lỗi này cho biết máy chủ hiểu yêu cầu của bạn, nhưng từ chối cấp quyền. Dưới đây là cách vượt qua vấn đề này và tiếp tục hành trình quét trang web của bạn.

Hiểu về lỗi 403 Forbidden

Lỗi 403 Forbidden xảy ra khi máy chủ từ chối truy cập vào tài nguyên được yêu cầu. Điều này có thể xảy ra vì một số lý do, bao gồm:

Vẫn đang gặp khó khăn với việc thất bại lặp đi lặp lại trong việc giải captcha gây khó chịu? Khám phá giải pháp giải captcha tự động liền mạch với công nghệ Auto Web Unblock được AI hỗ trợ của CapSolver!

Nhận mã giảm giá CapSolver của bạn

Tăng ngân sách tự động hóa ngay lập tức!

Sử dụng mã giảm giá CAPN khi nạp tiền vào tài khoản CapSolver để nhận thêm 5% tiền thưởng cho mỗi lần nạp — không giới hạn.

Nhận mã giảm giá ngay bây giờ trong Bảng điều khiển CapSolver

.

- Chặn IP: Máy chủ có thể chặn các địa chỉ IP nếu phát hiện các yêu cầu bất thường hoặc có khối lượng lớn.

- Hạn chế User-Agent: Một số trang web hạn chế truy cập dựa trên chuỗi User-Agent, được dùng để xác định trình duyệt và thiết bị gửi yêu cầu.

- Yêu cầu xác thực: Truy cập một số trang có thể yêu cầu thông tin đăng nhập hoặc khóa API.

Các kỹ thuật để vượt qua lỗi 403

1. Xoay đổi địa chỉ IP

Máy chủ thường chặn các yêu cầu từ cùng một địa chỉ IP sau một ngưỡng nhất định. Sử dụng một nhóm máy chủ proxy để xoay đổi địa chỉ IP có thể giúp bạn tránh bị chặn. Các dịch vụ như Nstproxy hoặc Bright Data cung cấp các giải pháp proxy xoay đổi.

python

import requests

proxies = {

"http": "http://your_proxy_here",

"https": "http://your_proxy_here",

}

response = requests.get("http://example.com", proxies=proxies)2. Sử dụng User-Agent thực tế

Các máy chủ web có thể phát hiện và chặn các yêu cầu với chuỗi User-Agent đáng ngờ. Giả mạo chuỗi User-Agent để mô phỏng trình duyệt bình thường có thể giúp tránh bị phát hiện.

python

headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3"

}

response = requests.get("http://example.com", headers=headers)3. Triển khai giới hạn yêu cầu

Gửi quá nhiều yêu cầu trong một khoảng thời gian ngắn có thể kích hoạt giới hạn tốc độ. Việc thêm khoảng thời gian chờ giữa các yêu cầu có thể giúp bạn tránh bị phát hiện.

python

import time

for url in url_list:

response = requests.get(url)

time.sleep(5) # Chờ 5 giây4. Xử lý xác thực

Một số tài nguyên yêu cầu xác thực. Sử dụng cookie hoặc khóa API cho các yêu cầu xác thực có thể vượt qua các hạn chế truy cập.

python

cookies = {

"session": "your_session_cookie_here"

}

response = requests.get("http://example.com", cookies=cookies)5. Sử dụng trình duyệt không đầu

Trình duyệt không đầu như Puppeteer hoặc Selenium mô phỏng tương tác của người dùng thực tế và có thể giúp vượt qua các biện pháp chống quét trang web phức tạp.

python

from selenium import webdriver

options = webdriver.ChromeOptions()

options.add_argument('headless')

driver = webdriver.Chrome(options=options)

driver.get("http://example.com")

html = driver.page_source6. Vượt qua các thách thức CAPTCHA

Ngoài lỗi 403, người quét trang web thường gặp phải CAPTCHA, được thiết kế để chặn truy cập tự động. CAPTCHA như reCAPTCHA yêu cầu giải các thách thức hình ảnh hoặc tương tác để chứng minh rằng yêu cầu được thực hiện bởi người dùng thật.

Để giải các thách thức này, bạn có thể sử dụng các dịch vụ như CapSolver cung cấp giải pháp giải CAPTCHA tự động. CapSolver hỗ trợ nhiều loại CAPTCHA và cung cấp tích hợp dễ dàng với các công cụ quét trang web.

Kết luận

Gặp phải lỗi 403 Forbidden khi quét trang web có thể gây khó chịu, nhưng hiểu rõ nguyên nhân và áp dụng các kỹ thuật phù hợp có thể giúp bạn vượt qua rào cản này. Dù là xoay đổi IP, sử dụng chuỗi User-Agent thực tế, giới hạn yêu cầu, xử lý xác thực hay sử dụng trình duyệt không đầu, các phương pháp này có thể giúp bạn tiếp tục trích xuất dữ liệu quý giá từ web.

Bằng cách tuân theo các chiến lược này, bạn có thể quản lý và vượt qua lỗi 403 hiệu quả, đảm bảo quá trình quét trang web diễn ra mượt mà và thành công hơn.

Câu hỏi thường gặp

1. Việc vượt qua lỗi 403 Forbidden trong quét trang web có hợp pháp không?

Việc vượt qua lỗi 403 Forbidden không phải là bất hợp pháp theo bản chất, nhưng tính hợp pháp phụ thuộc vào điều khoản dịch vụ của trang web, quy tắc robots.txt và luật pháp địa phương. Việc quét dữ liệu công khai cho mục đích hợp pháp thường được phép, trong khi vượt qua xác thực, hàng rào thanh toán hoặc các hạn chế rõ ràng có thể vi phạm điều khoản hoặc quy định. Luôn kiểm tra chính sách của trang web mục tiêu trước khi quét.

2. Tại sao tôi vẫn nhận được lỗi 403 ngay cả khi sử dụng proxy và User-Agent?

Lỗi 403 có thể tiếp tục nếu trang web sử dụng các hệ thống phát hiện bot tiên tiến như phân tích hành vi, định danh thiết bị hoặc thách thức CAPTCHA. Trong trường hợp này, việc xoay đổi IP và giả mạo User-Agent đơn giản có thể không đủ. Kết hợp giới hạn tốc độ yêu cầu, quản lý phiên, trình duyệt không đầu và dịch vụ giải CAPTCHA như CapSolver có thể cải thiện đáng kể tỷ lệ thành công.

3. Phương pháp nào đáng tin cậy nhất để tránh lỗi 403 cho quét trang web quy mô lớn?

Đối với quét trang web quy mô lớn, phương pháp đáng tin cậy nhất là chiến lược đa lớp: proxy xoay đổi chất lượng cao, định danh trình duyệt thực tế, tốc độ yêu cầu được kiểm soát, xử lý xác thực đúng cách và giải CAPTCHA tự động. Sử dụng trình duyệt không đầu với các giải pháp web unblock dựa trên AI giúp mô phỏng hành vi người dùng thực tế và giảm khả năng bị chặn 403 lặp lại.

Xem thêm

web scrapingApr 22, 2026

Kiến trúc Trích xuất Dữ liệu Từ Web bằng Rust cho Trích xuất Dữ liệu Có Thể Mở Rộng

Học kiến trúc gỡ mã web Rust có thể mở rộng với reqwest, scraper, gỡ mã bất đồng bộ, gỡ mã trình duyệt không đầu, xoay proxy và xử lý CAPTCHA tuân thủ.

web scrapingFeb 17, 2026

Cách giải CAPTCHA trên Nanobot bằng CapSolver

Tự động hóa việc giải CAPTCHA với Nanobot và CapSolver. Sử dụng Playwright để giải reCAPTCHA và Cloudflare tự động.